AIが人間の能力を拡張し、まるでプロフェッショナルな”超能力”を与える時代が到来しました。特に、安全性と倫理を最重視するAnthropicのClaude AIは、その進化の最前線にいます。本記事では、Claudeのプロダクトリードが語るAIの未来像を深掘りし、その技術的背景、Anthropicが掲げる「責任あるAI」の哲学、そして日本市場への影響について専門家の視点から解説します。

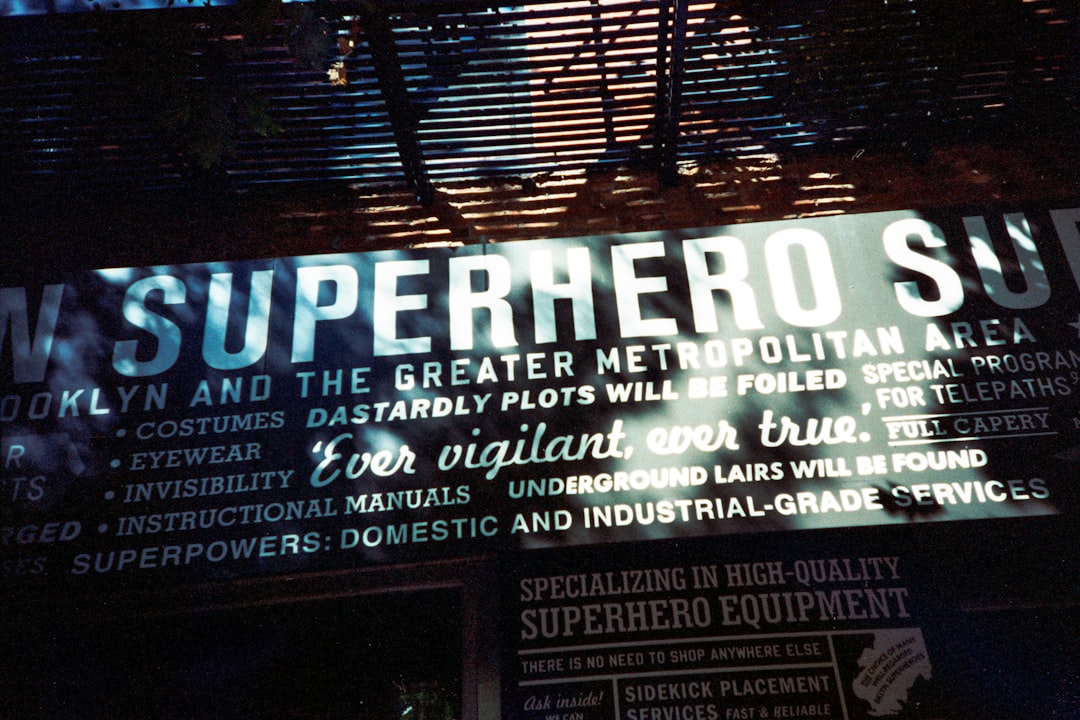

AIが解き放つ「プロフェッショナルな超能力」

現代のAI、特に大規模言語モデル(LLM)は、単なる自動化ツールを超え、人間の認知能力や創造性を劇的に拡張する「超能力」を私たちに提供しています。例えば、数千ページに及ぶ専門文書の要約、複雑なデータセットからの洞察抽出、あるいはゼロからの企画書やマーケティングコピーの生成など、これまで専門家が何時間もかけていた作業をAIは瞬時にこなします。

この能力の背景には、大規模言語モデル(LLM) ※LLMとは:大量のテキストデータから言語のパターンや構造を学習し、人間のような自然な文章を生成・理解できるAIモデル の進化があります。特に、Transformerアーキテクチャ ※Transformerアーキテクチャとは:Googleが開発したニューラルネットワークモデルで、自然言語処理分野に革命をもたらしました。文中の単語間の関係性を効率的に捉える「アテンション機構」が特徴です。 の登場により、AIは文脈を深く理解し、より一貫性のある、高品質なテキストを生成できるようになりました。

日本企業においても、この「超能力」は多岐にわたる活用が期待されます。例えば、研究開発部門では最新論文の高速レビュー、営業部門では顧客との過去のやり取りを分析したパーソナライズされた提案作成、カスタマーサポートではFAQの自動生成や顧客問い合わせの一次対応など、生産性向上と新たな価値創出の可能性を秘めています。

Anthropicが掲げる「責任あるAI」の哲学

AIの能力が飛躍的に向上する一方で、その安全性と倫理的な側面への懸念も高まっています。Anthropicは、この課題に真摯に向き合う企業の一つであり、設立当初から「責任あるAI」の実現を最優先事項として掲げています。彼らが提唱する憲法AI(Constitutional AI) ※憲法AIとは:人間からの直接的なフィードバックだけでなく、事前に設定された倫理的原則やガイドライン(「憲法」)に基づいてAI自身が安全かつ倫理的な振る舞いを学習・評価するアプローチ ですは、AIが有害な出力を生成したり、不適切な行動をとったりしないよう、AI自身が自律的に学習し、調整するメカニズムです。

なぜ安全性がこれほど重要なのでしょうか。AIが誤った情報を生成するハルシネーション ※ハルシネーションとは:AIが事実に基づかない、もっともらしい虚偽の情報を生成してしまう現象 や、学習データに含まれる偏見を反映してしまうバイアス ※バイアスとは:AIが特定の属性や集団に対して不公平な判断や出力をする傾向 の問題は、社会に深刻な影響を及ぼす可能性があります。Anthropicは、これらのリスクを最小限に抑えることで、ユーザーがAIを信頼し、安心して利用できる環境を構築しようとしています。

日本企業がAIを導入する際も、データプライバシー、個人情報保護法、そして企業倫理といった側面を深く考慮する必要があります。Anthropicのアプローチは、特に高い倫理基準が求められる金融、医療、公共サービスといった分野において、AI導入のハードルを下げる一助となるでしょう。

AIの未来像:パーソナル化と多機能化、そして日本市場

Claudeのプロダクトリードが描くAIの未来は、単なる高性能なツールに留まりません。それは、より個々のユーザーのニーズや文脈を深く理解し、まるで専属のアシスタントのように機能する、高度にパーソナライズされた存在です。AIは、私たちの好み、作業スタイル、目標を学習し、最適な情報提供やタスク支援を行うようになるでしょう。

また、未来のAIは、テキストだけでなく、画像、音声、動画といった多様な情報を理解し、生成できるマルチモーダルAI ※マルチモーダルAIとは:テキスト、画像、音声など、複数の異なる種類のデータを同時に処理・理解・生成できるAI の方向へと進化します。これにより、例えば「このグラフを分析し、その内容を要約した上で、関連する画像を生成してプレゼンテーション資料を作成してほしい」といった複雑な指示にも、AIが自律的に対応できるようになります。

さらに、AIは単一のタスクを実行するだけでなく、複数のタスクを連携させ、自律的に目標達成に向けて行動するエージェントAI ※エージェントAIとは:特定の目標を達成するために、計画立案、情報収集、ツール利用、自己修正などを自律的に行い、一連のタスクを遂行できるAI の側面を強めていくでしょう。以下に、AIエージェントのタスク実行フローの例を示します。

graph TD

A["ユーザー指示"]

A --> B["タスク分解/計画立案"]

B --> C{"情報収集/ツール利用"}

C --> D["実行/生成"]

D --> E{"自己評価/修正"}

E --> F["結果提示"]

日本市場においては、少子高齢化による労働力不足が深刻化しており、AIはこれを補完する重要な役割を担う可能性があります。特に、製造業における生産管理の最適化、医療分野における診断支援や新薬開発、サービス業における顧客体験の向上など、特定の産業におけるAI活用が深化し、社会全体の生産性向上に貢献することが期待されます。

筆者の見解と今後の展望

AnthropicのClaude AIは、その安全性と倫理への強いコミットメントにより、生成AI市場において独自の地位を確立しています。OpenAIのGPTシリーズが汎用性と最先端の性能を追求する一方で、Claudeは特に企業利用や、信頼性が最優先される分野において、その真価を発揮するでしょう。日本企業は、データガバナンスやコンプライアンスへの意識が高いため、Claudeのような「責任あるAI」のアプローチは非常に魅力的です。

今後のAI技術の展望としては、より専門特化したAIモデルの登場が予想されます。特定の業界知識や業務プロセスに深く最適化されたAIは、汎用AIでは実現できないレベルの精度と効率性をもたらすでしょう。また、デバイス上でAI処理を行うエッジAI ※エッジAIとは:クラウドではなく、スマートフォンやIoTデバイスなどの端末(エッジ)側でAI処理を行う技術。リアルタイム性やプライバシー保護に優れます。 の進化により、リアルタイムでのAI活用がさらに広がり、私たちの日常生活や業務に溶け込む形でのAIアシスタンスが一般化すると考えられます。

日本企業がAI導入で成功を収めるためには、単に最新技術を導入するだけでなく、組織文化の変革と従業員のリスキリング ※リスキリングとは:新しいスキルや知識を習得し、新たな職務や役割に対応できるようにすること が不可欠です。AIはツールであり、それを最大限に活用できる人材と体制がなければ、その真の価値を引き出すことはできません。また、AIの倫理的な利用を保証するためのAIガバナンス ※AIガバナンスとは:AIシステムの開発、導入、運用において、倫理的、法的、社会的なリスクを管理し、責任ある利用を確保するための一連の枠組みやプロセス の確立も急務となるでしょう。人間とAIが協調し、それぞれの強みを活かす「Human-AI Collaboration」の深化こそが、未来の競争力を決定づける鍵となると筆者は考えます。

まとめ

- AIは人間の能力を拡張し、まるでプロフェッショナルな”超能力”を与える存在へと進化しています。

- AnthropicのClaude AIは、憲法AIを通じて安全性と倫理を最優先し、信頼できるAIの利用を推進しています。

- 未来のAIは、ユーザーのニーズを深く理解するパーソナルなアシスタントであり、複数の情報を処理するマルチモーダルAI、自律的にタスクを遂行するエージェントAIへと進化します。

- 日本市場では、AIは労働力不足の解消や特定の産業の生産性向上に貢献する大きな可能性を秘めています。

- AIを安全かつ効果的に活用するためには、企業はAIガバナンスの確立、従業員のリスキリング、そして人間とAIの協調を重視することが不可欠です。