AIの進化は目覚ましく、私たちの生活やビジネスに不可欠な存在となりつつあります。しかし、その裏側では、AIモデルの複雑化と大規模化が、膨大な計算リソースとそれに伴うコスト、そして電力消費という深刻な課題を生み出しています。特に、生成AIの推論処理においては、従来のハードウェアアーキテクチャがボトルネックとなり、その性能を十分に引き出せない「メモリウォール」問題が顕在化しています。

AI推論の壁「メモリウォール」とは何か?

現在、AIの計算処理の主役はGPU(Graphics Processing Unit)です。GPUは並列計算に優れ、AIモデルの学習や推論に不可欠な存在ですが、その構造には課題があります。GPU自体が計算を担当し、AIモデルの重み(パラメーター)や中間データはVRAM(Video RAM)と呼ばれる専用メモリに格納されます。このGPUとVRAMの間でデータが頻繁に行き来する際、その転送速度がGPUの計算速度に追いつかず、処理全体のボトルネックとなってしまう現象が「メモリウォール」です。

例えるなら、F1マシン(GPU)が高速道路(計算)を走っているのに、ガソリンスタンド(VRAM)との往復(データ転送)に時間がかかり、本来のスピードが出せない状態です。このデータ転送にかかる時間とエネルギーは、AIモデルが大規模になるほど無視できないものとなり、推論の遅延や消費電力の増大に直結します。

Taalas HC1の革新:モデルを「焼き付けた」チップの衝撃

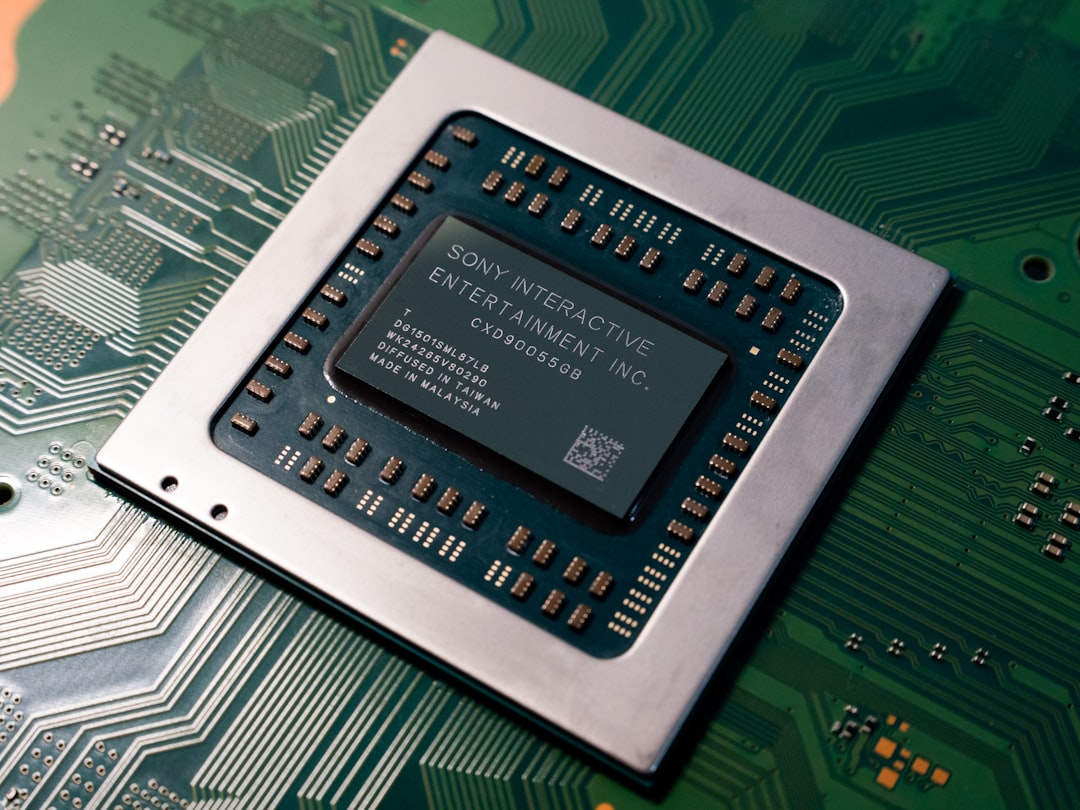

こうした課題に対し、カナダの新興企業Taalasは、まさに常識を覆すアプローチで解決策を提示しました。彼らが開発したAIチップ「HC1」は、Metaが提供するオープンソースの言語モデル「Llama 3.1 8B」を、なんと直接ハードウェア回路に「焼き付けた」ASIC(特定用途向け集積回路)です。

従来のGPUが汎用的な計算器であるのに対し、HC1は特定のAIモデルに特化することで、GPUとVRAM間のデータ転送パスを完全に排除しました。これにより、メモリウォール問題そのものを根本から解消し、以下のような驚異的な性能を実現しています。

- 超高速推論: 単一ユーザーでの推論速度は毎秒15,000~17,000トークンに達し、これは既存のソリューションと比較して約10倍の高速化です。

- 超低遅延: 応答速度は1ミリ秒未満。リアルタイム性が求められるアプリケーションでの活用が期待されます。

- 大幅なコスト削減: 製造コストは従来のソリューションの20分の1以下、消費電力は10分の1以下に抑えられます。

- シンプルな冷却: 従来のGPUデータセンターで必須だった高価な水冷システムが不要となり、一般的な空冷で運用可能です。

Taalasは、このHC1チップを台湾積体電路製造(TSMC)の6nmプロセスで製造しており、その技術力の高さが伺えます。このアプローチは、AI推論の効率と経済性を劇的に向上させる可能性を秘めています。

圧倒的性能の裏にある「柔軟性」とのトレードオフ

HC1の性能は目を見張るものがありますが、この「モデル特化型」というアプローチには、いくつかの重要なトレードオフが存在します。

モデル更新への追従性

AIモデルは日々進化し、週単位、あるいは日単位で新しいバージョンや改良版がリリースされることも珍しくありません。HC1のように特定のモデルをハードウェアに「焼き付ける」方式では、モデルが更新されるたびにチップを再設計・再製造する必要が生じます。これは、開発期間とコストを考えると、AIの急速な進化に追従できるのかという疑問符が付きます。TaalasがHC1の開発に2年半を要したことを考えると、この課題は特に顕著です。

汎用性の限界

HC1はLlama 3.1 8Bモデルに特化しているため、MoE(Mixture of Experts)のような超大型モデルや、多様なAIモデルを柔軟に運用したいデータセンターにとっては、初期導入の柔軟性に課題が残ります。汎用GPUが様々なモデルに対応できるのに対し、HC1は特定の用途に最適化されているため、その適用範囲は限定的です。

エッジAIへの適用可能性

元記事の考察にもあるように、HC1のような超低遅延はロボット、自動運転、医療機器といったエッジAI(デバイス側でのAI処理)の分野で非常に魅力的です。しかし、現在のHC1はPCIeカード1枚で200Wを超える消費電力があり、これはスマートフォンや組み込み機器、自動車のECU(通常5~30W)といった典型的なエッジデバイスの電力上限を大きく超えています。現時点では、データセンター向けのソリューションとして位置づけられています。

筆者の独自分析・見解: AIインフラの未来を再定義する可能性と日本への示唆

Taalas HC1のアプローチは、AIインフラの未来に新たな選択肢を提示するものです。汎用性を追求するNVIDIAのGPU戦略とは一線を画し、特定のAIモデルに特化することで「極限の効率」を追求する。これは、AIの進化が多岐にわたる中で、必ずしもすべてのAIが汎用的なハードウェアを必要とするわけではない、という現実を浮き彫りにします。

特に、Llama 3.1 8Bのようなオープンソースモデルは、その性能と手軽さから多くの企業や開発者に利用されています。もし特定のモデルが長期的に安定して利用される見込みがあれば、HC1のようなASICは、その推論コストを劇的に削減し、結果としてAIサービスの普及を加速させる可能性があります。

データセンターの電力問題への貢献

データセンターの電力消費は、AI時代において深刻な環境問題および経済的課題となっています。NVIDIAの高性能GPUを搭載したAIラックが120~600kWもの電力を消費し、高価な水冷システムを必要とする中、HC1搭載ラックが12~15kWで空冷運用可能というのは、データセンターの運用コストと環境負荷を劇的に低減する画期的なソリューションです。これは、AIの持続可能な発展を考える上で非常に重要な要素となるでしょう。

日本市場への示唆

日本企業にとって、AI導入の障壁の一つに、その高コストが挙げられます。特に、大規模なAIモデルの推論を自社で行う場合、GPUインフラへの投資は大きな負担となります。HC1のようなソリューションが普及すれば、特定のオープンソースモデルを利用したAIサービスを、はるかに低コストで運用できるようになるかもしれません。これにより、AI活用のハードルが下がり、中小企業やスタートアップでも、より積極的にAIをビジネスに取り入れる機会が生まれる可能性があります。

もちろん、モデルの更新頻度や汎用性といった課題は残りますが、特定のタスクに特化したAIモデル(例えば、社内文書の要約、特定の顧客対応チャットボットなど)を運用する場合には、HC1のような専用チップが強力な選択肢となり得ます。AIハードウェアの多様化は、AIエコシステム全体の健全な発展を促し、各企業が自社のニーズに最適なソリューションを選択できる未来へと繋がるでしょう。

まとめ

- 「メモリウォール」の解消: Taalas HC1は、GPUとVRAM間のデータ転送ボトルネックを排除し、AI推論の遅延と消費電力を大幅に削減する。

- Llama 3.1 8B特化型ASIC: 特定のオープンソースモデルを直接ハードウェアに組み込むことで、毎秒17,000トークンという超高速処理と1ミリ秒未満の低遅延を実現。

- 圧倒的なコストパフォーマンス: 従来のソリューションと比較して、製造コストは20分の1、消費電力は10分の1に削減され、データセンターの運用効率を劇的に向上させる。

- 柔軟性とのトレードオフ: モデル更新への追従性や汎用性には課題が残るものの、特定のモデルを長期運用する場合には強力な選択肢となる。

- AIインフラの多様化: Taalasのアプローチは、AIハードウェア市場に新たな競争と選択肢をもたらし、AIの持続可能な発展とコスト削減に貢献する可能性を秘めている。日本企業にとっても、AI活用のハードルを下げる間接的なメリットが期待される。